Os vídeos “fake” estão se tornando cada vez melhores, e agora ficou ainda mais fácil criá-los. Para propósitos inofensivos, como, por exemplo, um avatar em movimento, é uma evolução muito legal. Mas para outros casos, como utilizar a tecnologia para assediar alguém online, pode ser algo preocupante.

Pesquisadores do Centro de Inteligência Artificial da Samsung em Moscou e o Instituto de Ciência e Tecnologia de Skolkovo publicaram um estudo – Few-Shot Adversarial Learning of Realistic Neural Talking Head Models (Aprendizagem Adversarial de Poucas-Imagens de Modelos de Cabeça Neural Falantes Realistas) – nesta semana que ilustra como o sistema deles é capaz de criar uma cabeça falante virtual com poucas imagens. Enquanto pesquisadores têm anunciado no último ano diversas formas de criar deepfakes – em que se utiliza machine learning para criar um vídeo falso ultrarrealista de alguém – ainda há um pré-requisito crucial. É necessário coletar muitas imagens de um indivíduo para gerar um deepfake realista dele.

Claro que isso não é algo impossível de fazer se você tiver uma ferramenta open-source de captura de fotos e a pessoa publicou fotos ou vídeos online suficientes de si própria. Mas isso ainda era um obstáculo e indicou às vítimas que elas precisavam ser mais cuidadosas em relação ao que compartilhavam na internet. Mas esse novo sistema torna essas criações muito mais fáceis e rápidas.

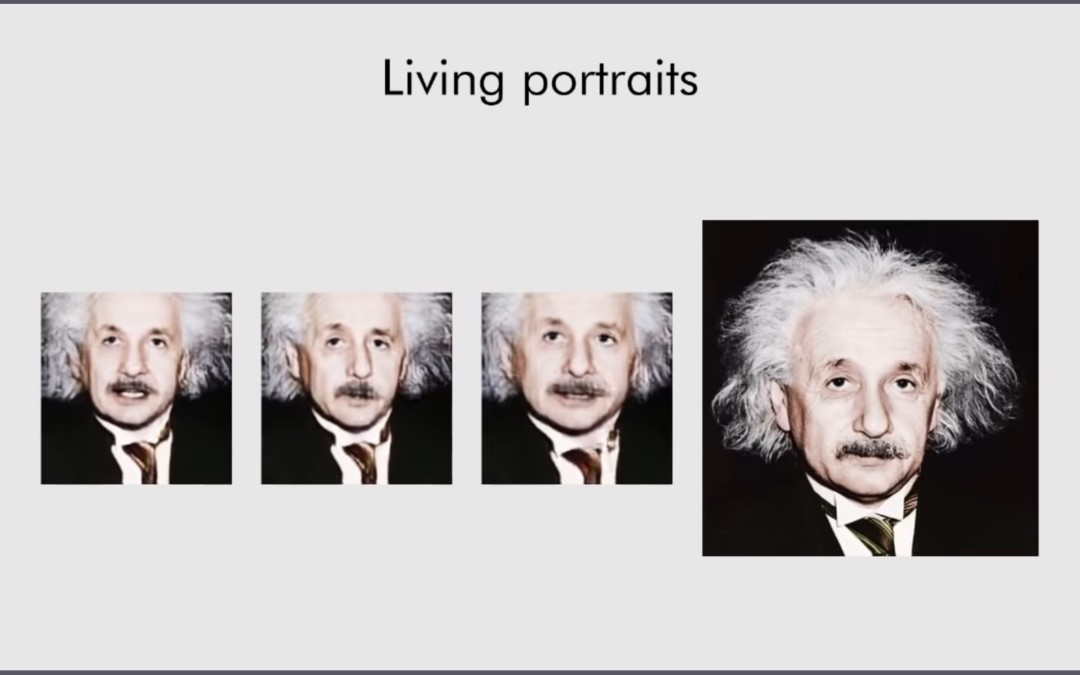

Os pesquisadores escrevem no estudo que o sistema pode criar “modelos de cabeças falantes a partir de algumas imagens” e “com tempo de treinamento limitado”. Para criar um deepfake, é preciso alimentar uma rede neural com as diversas fotos do indivíduo e ela, então, vai gerar um vídeo manipulado. Os pesquisadores alegam que seu sistema precisa de apenas uma foto, e não leva muito tempo para aprender com os dados de treinamento para criar o vídeo fake.

Segundo eles, para o “realismo perfeito”, o modelo foi treinado com 32 imagens, o que ainda é um número bem pequeno e fácil de coletar nessa era de compartilhamento online excessivo. É difícil não imaginar alguém sendo capaz de coletar essas imagens com uma visita rápida a um perfil no Facebook. Isso mostra como essa tecnologia está se desenvolvendo rápido.

Há alguns exemplos no estudo mostrando modelos de cabeças falantes geradas apenas com uma única imagem, e isso mostra como o sistema consegue colocar algo estático em movimento, com quadros da Mona Lisa e da Moça com Brinco de Pérola fazendo diversas expressões. Esses vídeos são ainda mais perturbadores – com apenas uma imagem, o sistema foi capaz de gerar vídeos bem realistas. E, em muitos dos exemplos, não é tão fácil identificar que eles são completamente falsos.

No estudo, os pesquisadores observam que esse tipo de tecnologia pode ter “aplicações práticas para telepresença, incluindo conferências em vídeo e jogos multi-player, além da indústria de efeitos especiais”. À medida que as empresas de tecnologia investem em avatares animados e realidade virtual, essa tecnologia parece ser um passo natural em direção a visuais cada vez mais personalizados e realistas. Também parece ser um passo natural para áreas como estúdios de cinema que queiram, por exemplo, fazer uma recriação pós-morte de um ator em tempo recorde.

Mas seria irresponsável exaltar essa tecnologia sem apontar para a ameaça muito real que ela representa para vítimas de manipulação de vídeos. Na verdade, quando o deepfake tornou-se público, era apenas questão de tempo até a tecnologia ser utilizada contra mulheres. A triste realidade é que sempre haverá pessoas de mau caráter online que vão explorar esse tipo de tecnologia e, à medida que ela se desenvolve, sempre haverá pessoas tentando torná-la mais fácil e mais eficiente também.